聚类介绍

聚类基本上是一种无监督学习方法。无监督学习方法是一种方法, 其中我们从包含输入数据的数据集中获取引用而没有标记的响应。通常, 它用作查找有意义的结构, 说明性的基础过程, 生成特征以及一组示例中固有的分组的过程。

聚类是将总体或数据点划分为若干组,使同一组中的数据点更类似于同一组中的其他数据点,而不同于其他组中的数据点。它基本上是一个物体的集合,基于它们之间的相似和不同。

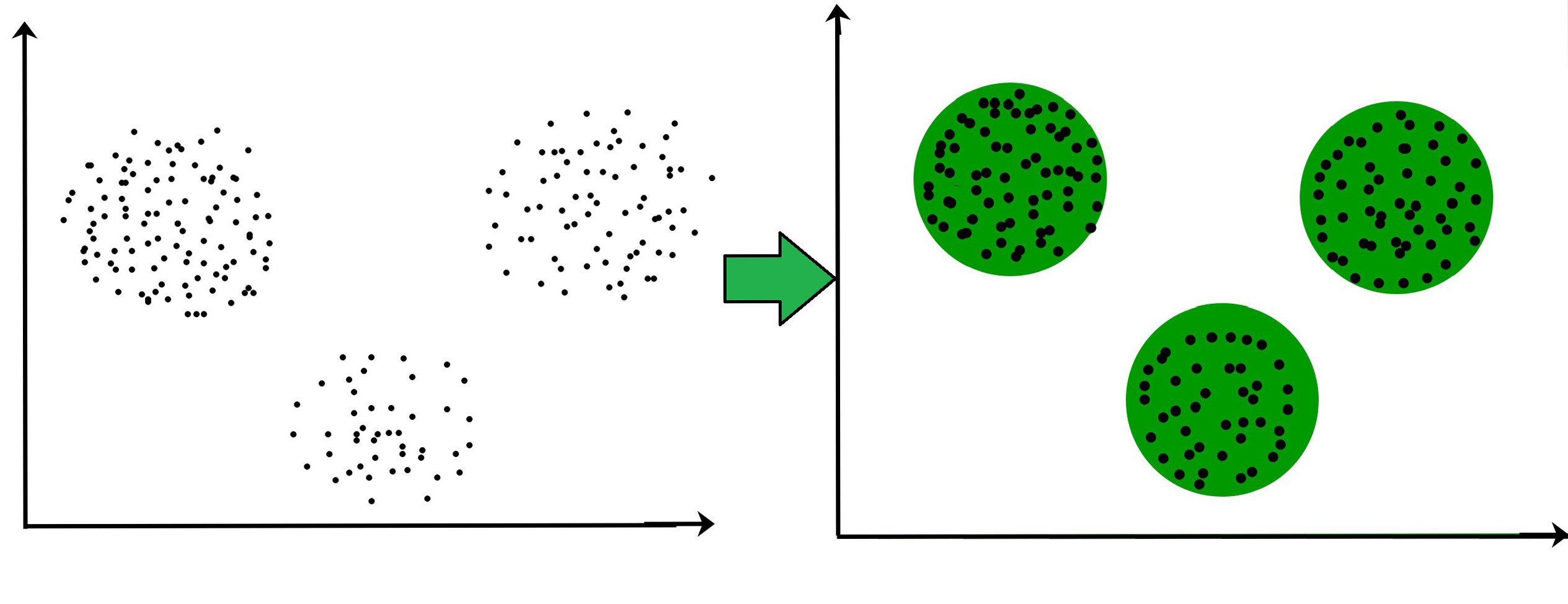

对于ex -在下面的图表中聚集在一起的数据点可以被分为一个单独的组。我们可以辨别出这些聚类,在下面的图片中我们可以辨别出有3个聚类。

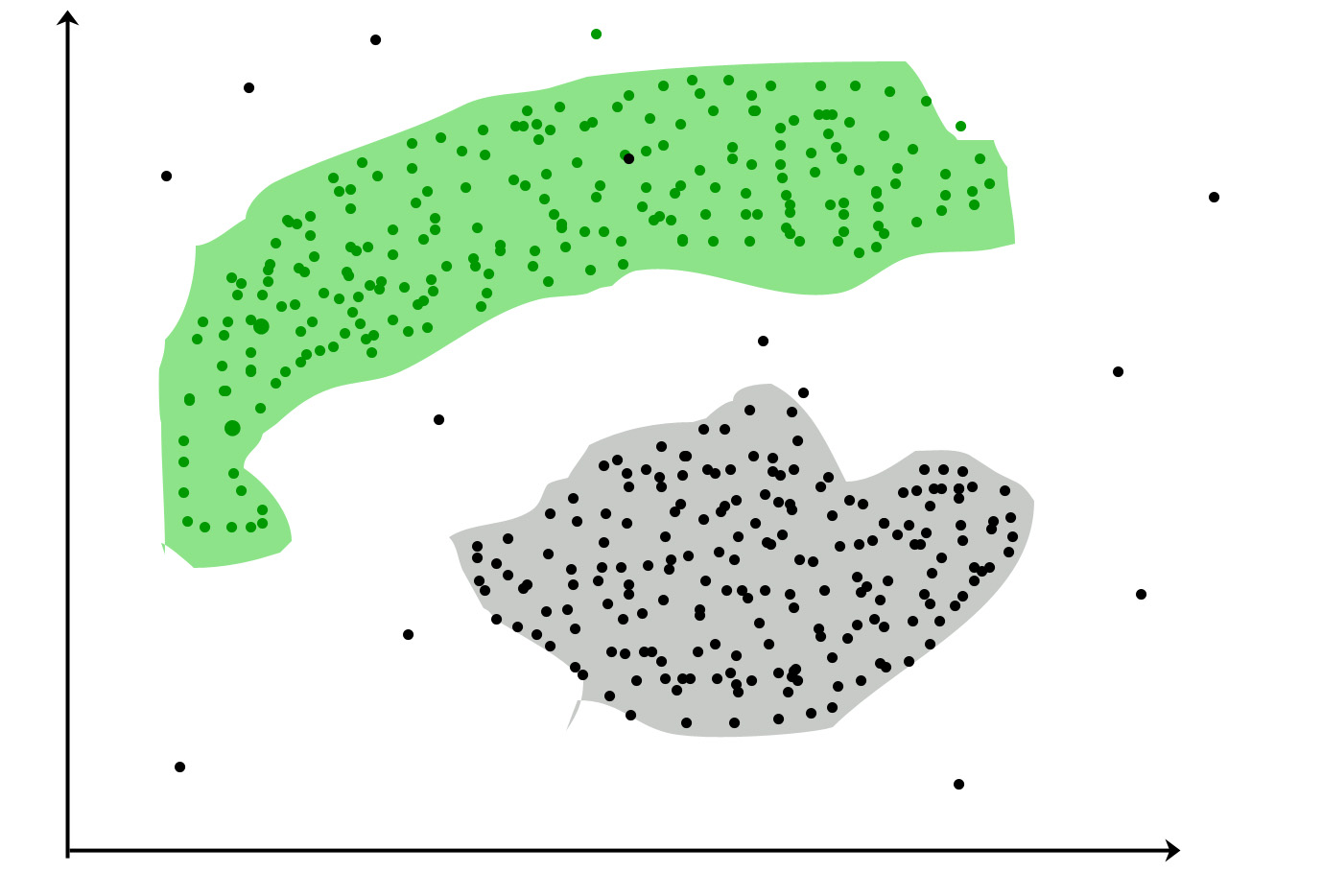

聚类不必是球形的。如 :

DBSCAN:带噪声的应用程序的基于密度的空间聚类

通过使用数据点位于聚类中心给定约束范围内的基本概念对这些数据点进行聚类。各种距离方法和技术被用于离群值的计算。

为什么要聚类?

聚类非常重要, 因为它决定了存在的未标记数据之间的固有分组。没有好的聚类标准。这取决于用户, 他们可以使用什么标准来满足他们的需求。例如, 我们可能有兴趣寻找同类组的代表(数据约简), 寻找"自然聚类"并描述其未知属性("自然"数据类型), 寻找有用和合适的分组("有用"数据类)或查找异常数据对象(异常检测)。该算法必须做出一些构成点相似性的假设, 并且每个假设都构成不同且同等有效的聚类。

聚类方法:

基于密度的方法:这些方法将聚类视为与空间中低密度区域有一定相似性和差异性的稠密区域。这些方法具有较好的准确性和合并两个聚类的能力。例如DBSCAN(基于密度的带噪声空间聚类应用),OPTICS(排序点识别聚类结构)等。

基于层次的方法:

用这种方法形成的聚类基于层次结构形成树型结构。使用先前形成的集群形成新的集群。它分为两类

- 集聚的(自下而上的方法)

- 分裂性(自上而下的方法)

例子CURE(使用代表进行聚类), BIRCH(平衡迭代式减少聚类和使用层次结构)等等

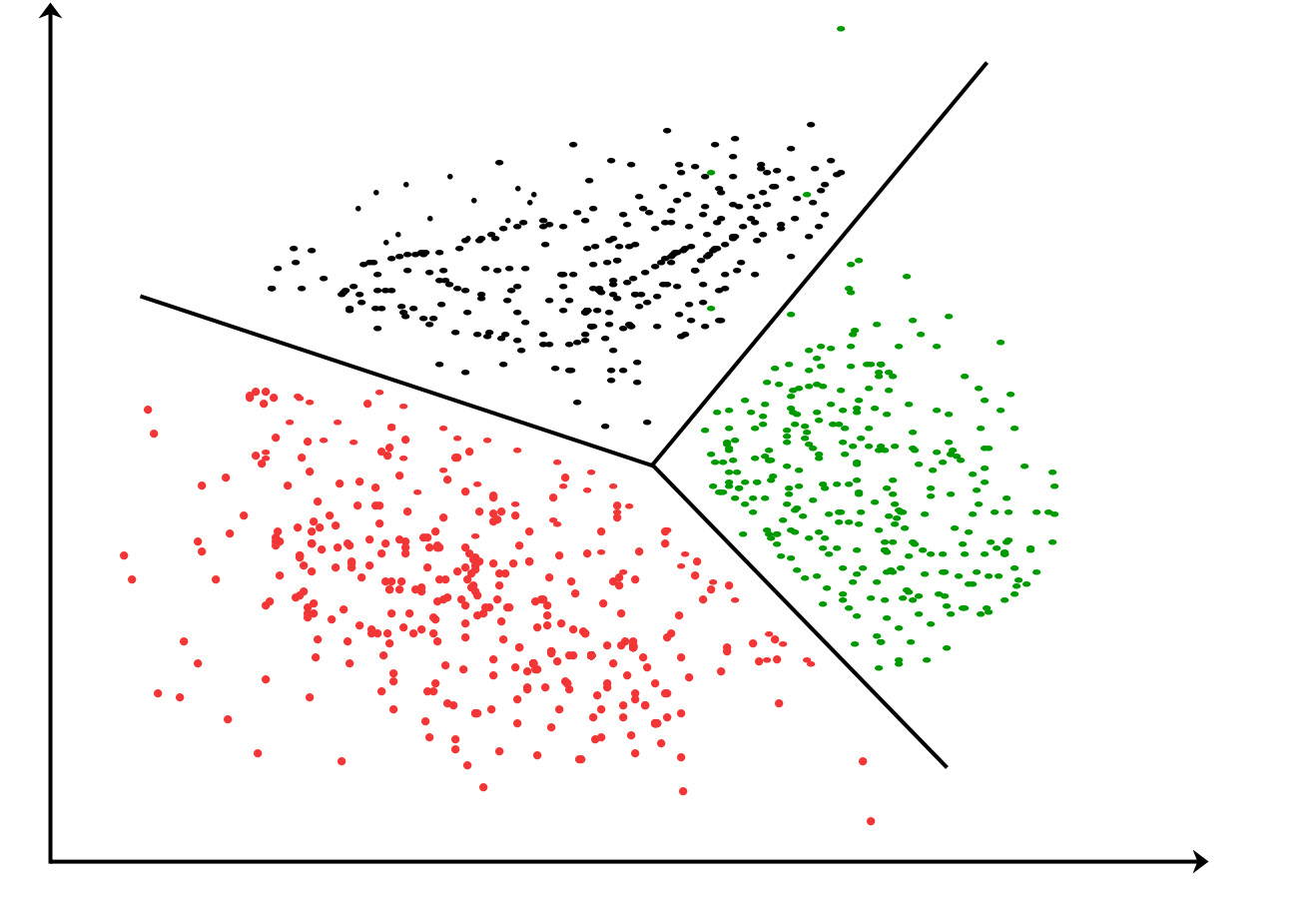

分区方法:这些方法将对象划分为k个聚类,每个聚类形成一个聚类。该方法用于优化以距离为主要参数时的客观判据相似性函数,如K-means、CLARANS(基于随机搜索的聚类大型应用)等。

基于网格的方法:在这种方法中,数据空间被表述为有限数量的单元,形成一个网格状结构。在这些网格上完成的所有聚类操作都是快速的,并且与数据对象的数量无关,例如STING(统计信息网格)、wave聚类、CLIQUE(任务聚类)等。

聚类算法:

K均值聚类算法–这是解决聚类问题的最简单的无监督学习算法。K-means算法将n个观测值划分为k个聚类, 其中每个观测值属于该聚类, 并且最接近的均值用作该聚类的原型。

聚类在不同领域的应用

- 市场营销:它可用于表征和发现用于市场营销目的的客户群。

- 生物学:它可以用于在不同种类的动植物之间进行分类。

- 图书馆:它用于根据主题和信息将不同的书籍聚集在一起。

- 保险 :它用于确认客户, 他们的策略并识别欺诈。

城市规划:它用于制作房屋组并根据其地理位置和其他因素研究其价值。

地震研究:通过了解受地震影响的区域, 我们可以确定危险区域。

参考文献:

维基:https://en.wikipedia.org/wiki/Cluster_analysis

层次聚类:https://en.wikipedia.org/wiki/Hierarchical_clustering

Ijarcs:http://www.ijarcs.info/index.php/Ijarcs/article/viewFile/3707/3199

matteucc:https://home.deib.polimi.it/matteucc/Clustering/tutorial_html/

analyticsvidhya:https://www.analyticsvidhya.com/blog/2016/11/an-introduction-to-clustering-and-different-methods-of-clustering/

knowm:https://knowm.org/introduction-to-clustering/

![从字法上最小长度N的排列,使得对于正好为K个索引,a[i] a[i]+1](https://www.lsbin.com/wp-content/themes/begin%20lts/img/loading.png)